Es obvio que la inteligencia artificial (IA) ha experimentado un crecimiento exponencial en las últimas décadas. Abarcando sus casos de uso una amplia variedad de áreas. El deporte no es la excepción, y la IA se ha convertido en una herramienta clave en el ámbito deportivo, ayudando a mejorar el rendimiento de los deportistas, analizar el juego y ayudando en el desarrollo de … [Leer más...] acerca de Cuatro aplicaciones de la Inteligencia Artificial en el Deporte

Ciencia de datos

La ciencia de datos es un área de conocimiento interdisciplinar en el cual se utilizan procesos para recopilar, preparar, analizar, visualizar y modelar datos para extraer todo su valor. Pudiéndose emplear tanto con conjuntos de datos estructurados como no estructurados. Los científicos de datos, los profesionales de esta área deben poseer grandes conocimientos de estadística e informática. Además de conocimiento de los procesos que están modelando.

Con la ciencia de datos es posible revelar tendencias y obtener información para que tanto las empresas como las instituciones puedan tomar mejores decisiones. Basando estas así en conocimiento validado no en intuiciones.

Las publicaciones de esta sección abarca diferentes temas de áreas como la estadística, la minería de datos, el aprendizaje automático y la analítica predictiva.

Identificar el número de clústeres con Calinski-Harabasz en k-means e implementación en Python

Cuando se desea realizar análisis de clúster uno de los algoritmos más utilizados es k-means. Lo que se explica por los buenos resultados que suele ofrecer con la mayoría de los conjuntos de datos y su simplicidad. Pero tiene un problema, es necesario conocer el número de clústeres en los que se debe dividir el conjunto de datos. Por lo que existen diferentes métodos como el … [Leer más...] acerca de Identificar el número de clústeres con Calinski-Harabasz en k-means e implementación en Python

Cuatro aplicaciones de la Inteligencia Artificial en Sanidad

La inteligencia artificial (IA) está transformando la forma en que se abordan los problemas de salud. Produciendo importantes avances en el diagnóstico, tratamiento y prevención de enfermedades. En esta publicación vamos a mostrar algunas de las principales aplicaciones de la inteligencia artificial en sanidad.Diagnóstico y detección temprana de enfermedadesLa IA se … [Leer más...] acerca de Cuatro aplicaciones de la Inteligencia Artificial en Sanidad

Método del codo (Elbow method) para seleccionar el número óptimo de clústeres en K-means

Posiblemente la técnica más utilizada para identificar el número óptimo de clústeres en los que dividir un conjunto de datos con K-means sea el método del codo (elbow method). Lo que se explica porque es un método intuitivo y fácil de implementar. Solamente hay que identificar el punto en el que la disminución de la varianza intra-clúster se desacelera, lo que indica que … [Leer más...] acerca de Método del codo (Elbow method) para seleccionar el número óptimo de clústeres en K-means

Cuatro Aplicaciones de la Inteligencia Artificial en la Moda

La industria de la moda es un sector en constante evolución, donde la innovación y la creatividad son esenciales para mantenerse al día con las tendencias y las demandas de los consumidores. Por eso la inteligencia artificial (IA) puede ayudar también a esta industria. En esta publicación analizaré cuatro posibles aplicaciones de la inteligencia artificial en la … [Leer más...] acerca de Cuatro Aplicaciones de la Inteligencia Artificial en la Moda

Optimizar el número de clústeres con gap statistics

El mayor problema con el que nos podemos encontrar a la hora de usar el algoritmo de k-means es conocer el número de clústeres en los que se divide el conjunto de datos. Un hiperparámetro que en Scikit-learn debe ser indicado al construir el objeto. Por eso existen múltiples métodos para seleccionar este valor como los métodos del codo (elbow method), silueta (silhouette) o … [Leer más...] acerca de Optimizar el número de clústeres con gap statistics

Cuatro aplicaciones de la Inteligencia Artificial en Transporte y Logística

Las aplicaciones basadas en inteligencia artificial (IA) están revolucionando múltiples industrias en los últimos años, el transporte de mercancías y la logística no son una excepción. Siendo posible que en este sector una transformación sin precedentes en los próximos años. A continuación, se presentan cuatro de las principales aplicaciones de la inteligencia artificial en … [Leer más...] acerca de Cuatro aplicaciones de la Inteligencia Artificial en Transporte y Logística

Análisis de sentimientos en español con spaCy en Python

La semana pasada se vio cómo se puede realizar análisis se sentimientos en inglés con NLTK. A pesar de que NLTK es una librería muy potente, no cuenta con un lematizador para español, por lo que no es adecuado para trabajar en nuestro idioma. Una alternativa que sí permite realizar análisis de sentimientos en español en Python es spaCy, la cual también es bastante fácil de … [Leer más...] acerca de Análisis de sentimientos en español con spaCy en Python

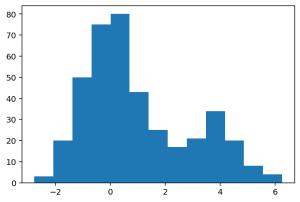

Seleccionar el número de bins en un histograma

Emplear la cantidad adecuada de bins a la hora de crear un histograma es un factor clave para visualizar estos de forma correcta. Cuando se usan demasiados bins, los histogramas resultantes muestran básicamente ruido, mientras el caso contrario, menos de los necesarios, puede ocultar los patrones que se desean observar en la gráfica. Problema que se ha explicado en detalle en … [Leer más...] acerca de Seleccionar el número de bins en un histograma

Cuatro Aplicaciones de la Inteligencia Artificial en Retail

El uso de la inteligencia artificial (IA) en el sector de retail ha permitido transformar el sector en los últimos años. Las empresas del sector que han adoptado el uso de IA han conseguido optimizar sus operaciones, impulsar la eficiencia y proporcionar un mejor servicio al cliente gracias al conocimiento de este. Lo que generalmente se traduce en ventajas competitivas. En … [Leer más...] acerca de Cuatro Aplicaciones de la Inteligencia Artificial en Retail

Análisis de sentimientos con NLTK en Python

La librería de referencia el Python para realizar procesado del lenguaje natural (PLN) es NLTK (Natural Language Toolkit). Lo que se debe a que prácticamente incluye todas las herramientas necesarias para trabajar con PLN, entre las que se incluyen tokenización, lematización, etiquetado gramatical, análisis sintáctico y análisis de sentimientos. Facilitando de esta manera el … [Leer más...] acerca de Análisis de sentimientos con NLTK en Python

¿Por qué es necesario estandarizar los datos en análisis de clúster?

A la hora de realizar un análisis de clúster, como puede ser el caso de k-means, puede surgir la duda de si es necesario o no estandarizar antes los datos antes. La estandarización, o normalización de los datos, es algo que facilita el entrenamiento de los modelos, por lo que es aconsejable realizar esta operación. Veamos algunos de los motivos por los que es necesario … [Leer más...] acerca de ¿Por qué es necesario estandarizar los datos en análisis de clúster?